A lo largo de esta serie de artículos, la exploración de los sistemas de IA ha evolucionado desde herramientas básicas -y falibles- de reconocimiento de patrones hasta plataformas más flexibles que pueden pensar, reflexionar y, en última instancia, lograr la metacognición recursiva. A medida que estas habilidades se desarrollan, el verdadero desafío es lograr que las personas y los sistemas inteligentes puedan trabajar juntos de manera responsable y exitosa.

Para avanzar con la innovación, los próximos pasos dependerán de construir confianza, establecer límites claros y fortalecer la colaboración con la IA, asegurando que se asuma la responsabilidad y se sigan las normas. La pregunta principal es: ¿cómo pueden las empresas trabajar con sistemas de IA lo suficientemente fuertes y seguros como para ayudarles a tomar decisiones en el mundo real?

Construir confianza a través de la autoconciencia de la IA

Una de las mejores formas de generar confianza en los sistemas avanzados de inteligencia artificial es permitirlos reconocer y exteriorizar cuándo sus propios juicios pueden ser erróneos. Las arquitecturas metacognitivas permiten que los modelos proporcionen predicciones en diferentes niveles de confianza interna, en lugar de mostrar todos los resultados como igualmente definidos.

En otras palabras, en lugar de presentar cada respuesta con el mismo tono de certeza, los diseños de IA más inteligentes permiten que el sistema señale cuán seguro está realmente del resultado dado. Esto conduce a los humanos tratar a la IA más como un colega, o al menos una herramienta con un elevado grado de autonomía con lo que se puede colaborar, que como un oráculo.

Cuando se utiliza con lógica de escalada organizada, el uso de la puntuación de confianza se vuelve muy útil. En entornos de apoyo al diseño clínico, por ejemplo, los investigadores encontraron que las recomendaciones producidas por IA y calificadas con unos niveles de confianzaentre el 90% y el 99% solo fueron ignoradas en el 1,7% de las ocasiones. Por otro lado, sus predicciones con unos niveles de confianza entre el 70% y el 79% fueron descartadas casi siempre. Este estudio muestra cómo la confianza calibrada afecta directamente cuándo intervienen los expertos humanos.

La arquitectura de humano en el bucle refuerza aún más la fiabilidad, al integrar el reconocimiento de patrones a escala de la máquina con la evaluación humana del contexto. Cuando los sistemas de IA detectan incertidumbre y se la trasladan a expertos humanos en el momento adecuado de un flujo de trabajo, disminuyen los riesgos de alucinación, cometen significativamente menos errores y apoyan mejores decisiones en entornos empresariales.

Con el tiempo, estos sistemas también ayudan a las organizaciones a definir roles de supervisión más claros y límites de decisión a través de flujos de trabajo complejos. Al señalar su incertidumbre en lugar de ocultarla, estas arquitecturas apoyan estrategias más sólidas de gobernanza de la IA a largo plazo, permitiendo una colaboración más fiable entre expertos humanos y sistemas inteligentes a gran escala.

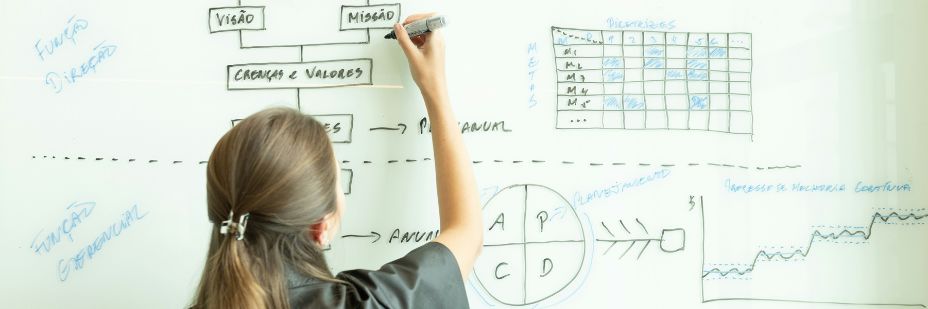

Establecer un modelo de gobernanza y rendición de cuentas de la IA

Las organizaciones deben dejar claro quién sigue siendo responsable de las decisiones tomadas con sistemas de IA a medida que mejoran en su capacidad para pensar y adaptarse. La gobernanza de la IA determina cómo se utilizan estos sistemas en entornos reales. El Marco de Gestión de Riesgos de IA del NIST, por ejemplo, afirma que una IA fiable necesita supervisión del ciclo de vida, transparencia y marcos explícitos de rendición de cuentas para garantizar que las personas de una organización sean, en último término, las responsables de cómo se utilizan los sistemas inteligentes.

A medida que más personas utilizan la inteligencia artificial en su trabajo, una gobernanza clara se vuelve aún más crucial. Según un informe, casi la mitad de los CEOs encuestados planean integrar la IA y el aprendizaje automático en sus negocios. Muchas empresas ya utilizan IA para ayudar a los trabajadores a identificar problemas de procesos, sugerir cambios y apoyar decisiones de mantenimiento predictivo. Y, a medida que estas habilidades se vuelven más comunes en las tareas cotidianas, crece la incertidumbre. Por ejemplo, el Foro Económico Mundial afirma que la IA debe ser más vigilada mientras se convierte en parte de los procesos del mundo real.

La responsabilidad de los sistemas de IA colaborativos debe recaer en las personas que los diseñan y operan, no en los propios sistemas. A medida que las organizaciones amplían la colaboración en IA en entornos complejos de toma de decisiones, muchos marcos internacionales, como los Principios de IA de la OCDE, subrayan que la supervisión humana real y la gestión de riesgos siguen siendo muy importantes.

El papel en evolución del experto humano

A medida que los sistemas de IA mejoran en el análisis y la predicción, el papel de un experto humano pasa de ser el de realizar repetidamente las mismas tareas a convertirse en el de guiar ordenadores inteligentes para usos reales. En lugar de sustituir al juicio experto, la IA se está volviendo más útil al mostrar tendencias, riesgos y sugerencias que deben entenderse antes de poder actuar.

Este cambio es muy evidente en el ámbito del mantenimiento predictivo. Por ejemplo, los sistemas de IA pueden analizar datos operativos para predecir cuándo se averiarán los equipos, evitando así interrupciones en el servicio. Esta capacidad permite a las empresas intervenir antes y reducir los tiempos de inactividad, manteniendo en funcionamiento instalaciones importantes. Pero si es la tecnología la que detecta el posible problema, son los especialistas humanos quienes revisan el hallazgo y planifican la solución adecuada. La IA proporciona el "qué", mientras que el experto define el "y qué" y "qué pasará después".

Por ello, el valor de la experiencia humana se está desplazando hacia dirigir los sistemas de IA en lugar de competir con ellos. A medida que la IA se vuelve más común en las operaciones, los profesionales deben encargarse de la interpretación del contexto, las decisiones de escalada y la integración de flujos de trabajo para garantizar una cooperación eficiente.

Algunas cualidades importantes que ayudarán a este paradigma:

Pensar críticamente

Supervisar a nivel de sistema

Crear conciencia de supervisión

Analizar decisiones estratégicas

Estas habilidades trabajan juntas para convertir a los especialistas humanos en directores estratégicos de sistemas inteligentes y no en simples receptores pasivos de un asesoramiento automatizado, fortaleciendo así un futuro de prácticas sólidas de cooperación en IA.

Diseñar sistemas de IA que señalen sus límites

Una de las cosas más cruciales a tener en cuenta al diseñar inteligencia artificial es cómo asegurarse de que pueda transmitir claramente cuándo necesita ayuda humana. Especialmente al conceder a la IA capacidades como agente, características como las calificaciones de confianza, los requisitos de precisión, los disparadores de escalada y los puntos de control de revisión estructurada permiten que los sistemas de IA se detengan en lugar de realizar acciones fuera de su rango de fiabilidad. Estas señales no debilitan la automatización, sino que generan confianza, haciendo que la colaboración sea más clara y predecible en diferentes situaciones operativas.

Construir alianzas que refuercen el juicio humano

A medida que los sistemas de IA mejoran, su valor a largo plazo depende menos de su autonomía y más de lo bien que ayuden a las personas a hacer su trabajo. Las empresas que creen sistemas capaces de manejar la incertidumbre, escalar problemas cuando lo necesitan y reforzar los límites de decisión estarán mejor capacitadas para crear flujos de trabajo fiables y sólidos. De este modo, los roles claros y una gobernanza cuidadosa de la IA sientan las bases para una colaboración sólida, permitiendo un uso responsable y escalable de esta tecnología.